1. Kehidupan Awal dan Pendidikan

Timnit Gebru memiliki latar belakang yang beragam dan pengalaman hidup yang membentuk minatnya pada etika teknologi dan keadilan sosial.

1.1. Kelahiran dan Latar Belakang

Gebru lahir pada tahun 1982 atau 1983 di Addis Ababa, Ethiopia. Kedua orang tuanya berasal dari Eritrea. Ayahnya, seorang insinyur listrik dengan gelar Doktor Filsafat (PhD), meninggal dunia ketika Gebru berusia lima tahun. Setelah itu, ia dibesarkan oleh ibunya, seorang ekonom. Kedua kakak perempuannya juga merupakan insinyur listrik.

1.2. Migrasi dan Pengalaman di AS

Pada usia 15 tahun, selama Perang Eritrea-Ethiopia, Gebru melarikan diri dari Ethiopia setelah beberapa anggota keluarganya dideportasi ke Eritrea dan dipaksa untuk berperang. Ia awalnya ditolak visa Amerika Serikat dan sempat tinggal sebentar di Irlandia, namun akhirnya menerima suaka politik di AS. Pengalaman ini ia gambarkan sebagai "menyedihkan". Gebru kemudian menetap di Somerville, Massachusetts, untuk melanjutkan sekolah menengah. Di sana, ia segera mengalami diskriminasi rasial, dengan beberapa guru menolak mengizinkannya mengambil mata pelajaran Advanced Placement tertentu meskipun ia adalah siswa berprestasi.

Setelah menyelesaikan sekolah menengah, sebuah insiden dengan polisi menjadi titik balik yang mengarahkan Gebru untuk fokus pada etika dalam teknologi. Seorang temannya, seorang wanita kulit hitam, diserang di sebuah bar, dan Gebru menelepon polisi untuk melaporkannya. Namun, alih-alih mencatat laporan penyerangan, temannya justru ditangkap dan ditahan. Gebru menyebutnya sebagai momen penting dan "contoh nyata rasisme sistemik".

1.3. Pendidikan dan Awal Karier

Pada tahun 2001, Gebru diterima di Universitas Stanford. Di sana, ia memperoleh gelar Sarjana Sains dan Magister Sains di bidang teknik elektro, dan kemudian gelar Doktor Filsafat di bidang visi komputer pada tahun 2017. Selama program PhD-nya, Gebru dibimbing oleh Fei-Fei Li, seorang tokoh terkemuka dalam bidang kecerdasan buatan. Gebru memiliki profil di Stanford University.

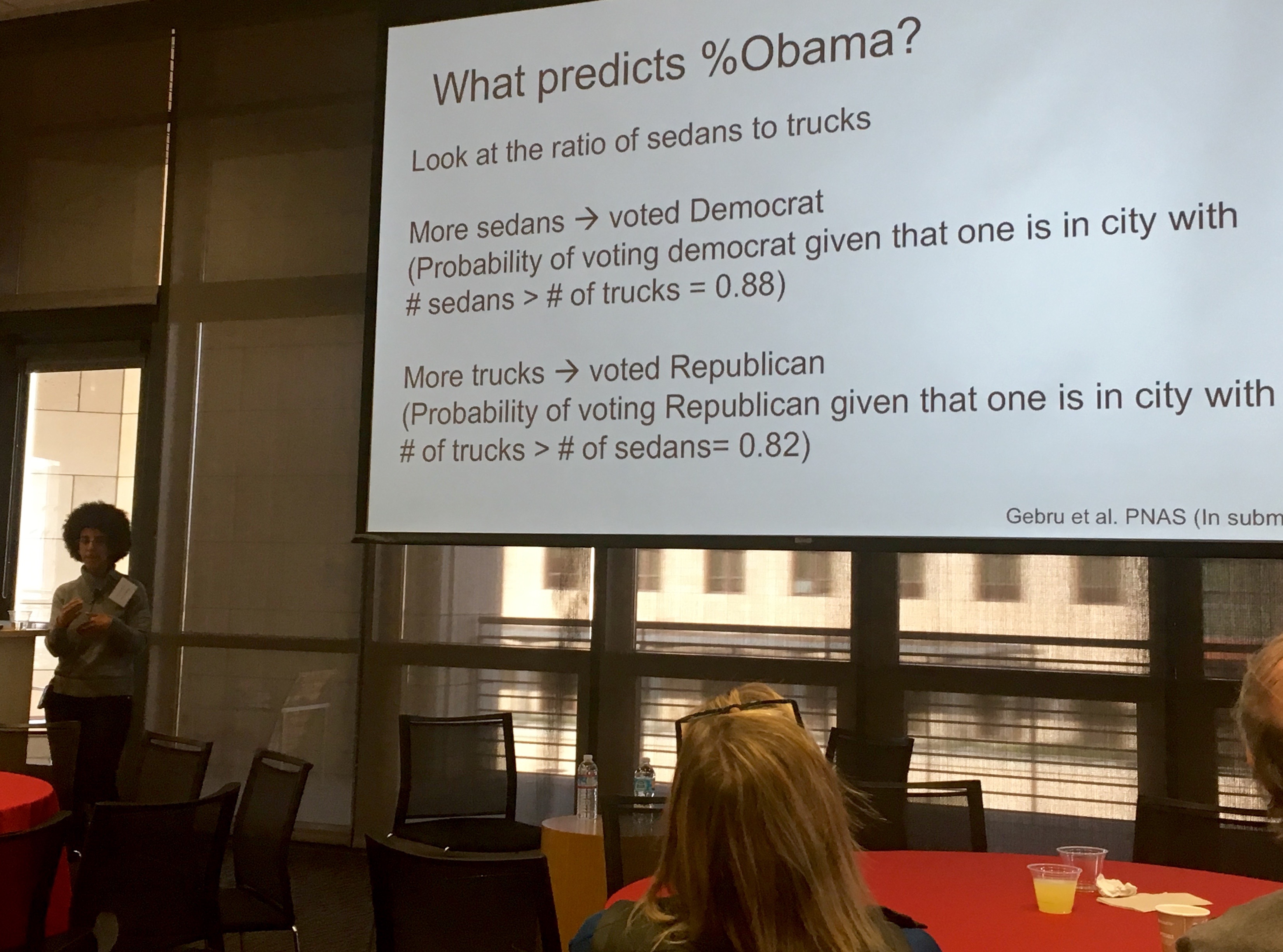

Penelitian doktoral Gebru berfokus pada penggunaan penambangan data dari gambar yang tersedia untuk umum. Ia tertarik pada jumlah uang yang dihabiskan oleh organisasi pemerintah dan non-pemerintah untuk mengumpulkan informasi tentang komunitas. Untuk mencari alternatif, Gebru menggabungkan pembelajaran mendalam dengan Google Street View untuk memperkirakan demografi lingkungan di Amerika Serikat. Penelitiannya menunjukkan bahwa atribut sosial ekonomi seperti pola pemungutan suara, pendapatan, ras, dan pendidikan dapat disimpulkan dari pengamatan mobil. Misalnya, jika jumlah truk pikap melebihi jumlah sedan, komunitas tersebut lebih mungkin memilih Partai Republik. Penelitian ini menganalisis lebih dari 15 juta gambar dari 200 kota terpadat di AS dan diliput secara luas oleh media, termasuk BBC News, Newsweek, The Economist, dan The New York Times.

Selama pemilihan presiden Amerika Serikat 2008, Gebru berkampanye mendukung Barack Obama. Pada tahun 2017, ia mempresentasikan penelitian doktoralnya di kompetisi LDV Capital Vision Summit, di mana para ilmuwan visi komputer mempresentasikan karya mereka kepada anggota industri dan pemodal ventura. Gebru memenangkan kompetisi tersebut, memulai serangkaian kolaborasi dengan pengusaha dan investor lain. Baik selama program PhD-nya pada tahun 2016 maupun pada tahun 2018, Gebru kembali ke Ethiopia untuk berpartisipasi dalam kampanye pemrograman AddisCoder yang dipimpin oleh Jelani Nelson.

Selama mengerjakan PhD-nya, Gebru menulis sebuah makalah yang tidak pernah diterbitkan tentang kekhawatirannya terhadap masa depan AI. Ia menulis tentang bahaya kurangnya keragaman di bidang tersebut, berpusat pada pengalamannya dengan polisi dan investigasi ProPublica tentang prediksi kepolisian, yang mengungkapkan proyeksi bias manusia dalam pembelajaran mesin. Dalam makalah tersebut, ia mengkritik "budaya klub laki-laki", merefleksikan pengalamannya di pertemuan konferensi di mana peserta laki-laki yang mabuk melecehkannya secara seksual, dan mengkritik pemujaan pahlawan terhadap para selebriti di bidang tersebut.

2. Karier dan Aktivitas

Perjalanan profesional Timnit Gebru mencerminkan dedikasinya terhadap pengembangan teknologi yang bertanggung jawab dan beretika, serta advokasinya untuk keragaman dan inklusi.

2.1. Karier Awal (Apple, Microsoft)

Gebru bergabung dengan Apple sebagai magang saat di Stanford, bekerja di divisi perangkat keras mereka membuat rangkaian elektronik untuk komponen audio, dan ditawari posisi penuh waktu pada tahun berikutnya. Manajernya di Apple menggambarkannya sebagai "tak kenal takut" dan sangat disukai oleh rekan-rekannya. Selama masa jabatannya di Apple, Gebru menjadi lebih tertarik pada pengembangan perangkat lunak, khususnya visi komputer yang dapat mendeteksi sosok manusia. Ia kemudian mengembangkan algoritma pemrosesan sinyal untuk iPad pertama. Pada saat itu, ia menyatakan tidak mempertimbangkan potensi penggunaan untuk pengawasan, dengan mengatakan "Saya hanya menganggapnya menarik secara teknis."

Jauh setelah meninggalkan perusahaan, selama gerakan #AppleToo pada musim panas 2021, yang dipimpin oleh insinyur Apple Cher Scarlett yang berkonsultasi dengan Gebru, Gebru mengungkapkan bahwa ia mengalami "begitu banyak hal mengerikan" dan "selalu bertanya-tanya bagaimana mereka berhasil lolos dari sorotan." Ia menyatakan bahwa akuntabilitas di Apple sudah lama tertunda, dan memperingatkan bahwa mereka tidak bisa terus bersembunyi dari pengawasan publik terlalu lama. Gebru juga mengkritik cara media meliput Apple dan raksasa teknologi lainnya, dengan mengatakan bahwa pers membantu melindungi perusahaan-perusahaan tersebut dari pengawasan publik.

Pada musim panas 2017, Gebru bergabung dengan Microsoft sebagai peneliti pascadoktoral di laboratorium Fairness, Accountability, Transparency, and Ethics in AI (FATE). Pada tahun 2017, Gebru berbicara di konferensi Fairness and Transparency, di mana MIT Technology Review mewawancarainya tentang bias yang ada dalam sistem AI dan bagaimana penambahan keragaman dalam tim AI dapat memperbaiki masalah tersebut. Dalam wawancaranya, Gebru menunjukkan bahwa ada bias yang ada pada pengembang perangkat lunak itu sendiri. Saat di Microsoft, Gebru turut menulis makalah penelitian berjudul Gender Shades, yang menjadi nama proyek yang lebih luas dari Massachusetts Institute of Technology yang dipimpin oleh rekan penulis Joy Buolamwini. Keduanya menyelidiki perangkat lunak pengenalan wajah, menemukan bahwa dalam satu implementasi tertentu, wanita kulit hitam 35% lebih kecil kemungkinannya untuk dikenali daripada pria kulit putih.

2.2. Riset Etika AI di Google

Gebru bergabung dengan Google pada tahun 2018, di mana ia bersama-sama memimpin tim tentang etika kecerdasan buatan dengan Margaret Mitchell. Ia mempelajari implikasi kecerdasan buatan, berusaha meningkatkan kemampuan teknologi untuk kebaikan sosial.

Pada tahun 2019, Gebru dan peneliti kecerdasan buatan lainnya menandatangani surat yang menyerukan Amazon untuk berhenti menjual teknologi pengenalan wajahnya kepada lembaga penegak hukum karena teknologi tersebut bias terhadap wanita dan orang kulit berwarna. Mereka mengutip sebuah studi yang dilakukan oleh peneliti MIT yang menunjukkan bahwa sistem pengenalan wajah Amazon memiliki lebih banyak kesulitan dalam mengidentifikasi wanita berkulit gelap dibandingkan perangkat lunak pengenalan wajah perusahaan teknologi lainnya. Dalam sebuah wawancara dengan The New York Times, Gebru lebih lanjut menyatakan bahwa ia percaya pengenalan wajah terlalu berbahaya untuk digunakan untuk tujuan penegakan hukum dan keamanan saat ini.

2.3. Makalah 'Stochastic Parrot' dan Keluarnya dari Google

Pada tahun 2020, Gebru dan lima rekan penulis menulis makalah berjudul "On the Dangers of Stochastic Parrots: Can Language Models Be Too Big? 🦜" (Tentang Bahaya Burung Beo Stokastik: Bisakah Model Bahasa Terlalu Besar?). Makalah ini mengkaji risiko model bahasa besar (LLM) yang sangat besar, termasuk jejak lingkungan, biaya finansial, ketidakjelasan model besar, potensi LLM untuk menunjukkan prasangka terhadap kelompok tertentu, ketidakmampuan LLM untuk memahami bahasa yang mereka proses, dan penggunaan LLM untuk menyebarkan disinformasi.

Pada Desember 2020, hubungan kerjanya dengan Google berakhir setelah manajemen Google memintanya untuk menarik makalah tersebut sebelum publikasi, atau menghapus nama semua karyawan Google dari makalah tersebut. Dari enam penulis, hanya Emily M. Bender yang saat itu tidak bekerja di Google. Dalam surat enam halaman yang dikirim ke daftar kolaborasi internal, Gebru menjelaskan bagaimana ia dipanggil ke rapat tanpa pemberitahuan singkat di mana ia diminta untuk menarik makalah tersebut. Ia kemudian meminta untuk mengetahui nama dan alasan setiap orang yang membuat keputusan tersebut, bersama dengan saran tentang cara merevisi makalah tersebut agar sesuai dengan keinginan Google. Ia menyatakan akan bekerja sama dengan Google untuk menentukan tanggal akhir masa kerja jika informasi tersebut tidak diberikan. Google tidak memenuhi permintaannya dan segera mengakhiri masa kerjanya, menyatakan bahwa mereka menerima pengunduran dirinya. Gebru menyatakan bahwa ia tidak secara resmi menawarkan untuk mengundurkan diri, dan hanya mengancam untuk melakukannya.

Jeff Dean, kepala riset AI Google, membalas dengan email yang menyatakan bahwa mereka membuat keputusan tersebut karena makalah tersebut mengabaikan terlalu banyak penelitian relevan baru-baru ini tentang cara-cara untuk mengurangi beberapa masalah yang dijelaskan di dalamnya, mengenai dampak lingkungan, dan bias model-model ini. Dean kemudian mempublikasikan email internalnya mengenai kepergian Gebru dan pemikirannya tentang masalah tersebut, membela proses makalah penelitian Google untuk "mengatasi masalah ambisius, tetapi melakukannya secara bertanggung jawab." Gebru dan pihak lain menyalahkan publikasi awal ini, dan keheningan Dean selanjutnya mengenai masalah tersebut, yang menurut Gebru telah mengkatalisasi dan memungkinkan pelecehan yang terjadi setelah responsnya. Gebru dilecehkan secara berulang oleh sejumlah akun sock puppet dan troll internet di Twitter, membuat komentar rasis dan cabul. Gebru dan para pendukungnya menuduh bahwa beberapa pelecehan berasal dari peneliti pembelajaran mesin Pedro Domingos dan pengusaha Michael Lissack, yang mengatakan bahwa karyanya adalah "advokasi yang menyamar sebagai sains." Lissack juga diduga melecehkan Mitchell dan Bender, bersama dengan rekan-rekan lain di tim Gebru sebelumnya. Akses akun Twitter Lissack ditangguhkan sementara pada 1 Februari 2021.

Gebru berulang kali menyatakan bahwa ia dipecat, dan hampir 2.700 karyawan Google serta lebih dari 4.300 akademisi dan pendukung masyarakat sipil menandatangani surat yang mengutuk dugaan pemecatan Gebru. Sembilan anggota Kongres mengirim surat kepada Google meminta klarifikasi mengenai keadaan di sekitar kepergian Timnit Gebru. Mantan tim Gebru menuntut agar Wakil Presiden Megan Kacholia dikeluarkan dari rantai manajemen tim. Kacholia diduga memecat Gebru tanpa memberitahu manajer langsung Gebru, Samy Bengio, terlebih dahulu, dan mantan tim Gebru menuntut Kacholia dan Dean meminta maaf atas perlakuan terhadap Gebru. Mitchell kemudian dipecat karena dugaan pengambilan dokumen rahasia bisnis dan data pribadi karyawan lain setelah mengkritik perlakuan Google terhadap karyawan yang bekerja untuk menghilangkan bias dan toksisitas dalam AI, termasuk dugaan pemecatan Gebru.

Menyusul publisitas negatif atas keadaan kepergiannya, Sundar Pichai, CEO Alphabet, perusahaan induk Google, secara terbuka meminta maaf di Twitter tanpa mengklarifikasi apakah Gebru dipecat atau mengundurkan diri, dan memulai penyelidikan selama berbulan-bulan atas insiden tersebut. Setelah kesimpulan tinjauan, Dean mengumumkan bahwa Google akan mengubah "pendekatan untuk menangani bagaimana karyawan tertentu meninggalkan perusahaan", tetapi masih tidak mengklarifikasi apakah kepergian Gebru dari Google bersifat sukarela. Selain itu, Dean mengatakan akan ada perubahan pada bagaimana makalah penelitian dengan topik "sensitif" akan ditinjau, dan tujuan keragaman, kesetaraan, dan inklusi akan dilaporkan kepada dewan direksi Alphabet setiap triwulan. Gebru menulis di Twitter bahwa ia "tidak mengharapkan lebih" dari Google dan menunjukkan bahwa perubahan tersebut disebabkan oleh permintaan yang diduga menjadi alasan pemecatannya, tetapi tidak ada yang dimintai pertanggungjawaban atas hal itu. Setelah kejadian itu, dua karyawan Google mengundurkan diri dari posisi mereka di perusahaan.

Setelah kepergiannya, Google mengadakan forum untuk membahas pengalaman rasisme di perusahaan, dan karyawan melaporkan kepada NBC News bahwa separuh waktu dihabiskan untuk mendiskreditkan Gebru, yang mereka anggap sebagai upaya perusahaan untuk menjadikannya contoh karena berani berbicara. Forum tersebut diikuti dengan sesi psikoterapi kelompok untuk karyawan kulit hitam Google dengan terapis berlisensi, yang menurut karyawan mengabaikan kerugian yang mereka rasakan akibat dugaan pemecatan Gebru. Pada Desember 2021, Reuters melaporkan bahwa Google sedang diselidiki oleh California Department of Fair Employment and Housing (DFEH) atas perlakuan terhadap wanita kulit hitam, setelah banyaknya keluhan formal tentang diskriminasi dan pelecehan oleh pekerja saat ini dan mantan pekerja. Penyelidikan ini muncul setelah Gebru, dan karyawan BIPOC lainnya, melaporkan bahwa ketika mereka menyampaikan pengalaman mereka dengan rasisme dan seksisme kepada Sumber Daya Manusia, mereka disarankan untuk mengambil cuti sakit dan terapi melalui program bantuan karyawan (EAP) perusahaan. Gebru, dan yang lainnya, percaya bahwa dugaan pemecatannya adalah tindakan balasan dan bukti bahwa Google bersifat rasis secara institusional. Google menyatakan bahwa mereka "terus fokus pada pekerjaan penting ini dan menyelidiki secara menyeluruh setiap kekhawatiran, untuk memastikan [Google] representatif dan adil."

2.4. Pendirian Distributed Artificial Intelligence Research Institute (DAIR)

Pada Juni 2021, Gebru mengumumkan bahwa ia sedang mengumpulkan dana untuk "meluncurkan lembaga penelitian independen yang dimodelkan berdasarkan pekerjaannya di tim AI Etis Google dan pengalamannya di Black in AI."

Pada 2 Desember 2021, ia meluncurkan Distributed Artificial Intelligence Research Institute (DAIR). DAIR diharapkan dapat mendokumentasikan dampak kecerdasan buatan pada kelompok-kelompok terpinggirkan, dengan fokus pada Afrika dan imigran Afrika di Amerika Serikat. Salah satu proyek awal organisasi ini berencana untuk menganalisis citra satelit kota-kota di Afrika Selatan dengan AI untuk lebih memahami warisan apartheid.

3. Bidang Riset Utama dan Kontribusi

Kontribusi Timnit Gebru telah secara signifikan membentuk diskursus tentang bias, keadilan, dan etika dalam kecerdasan buatan, menyoroti implikasi sosial dari teknologi ini.

3.1. Bias Algoritmik dan Keadilan

Gebru telah menjadi suara terkemuka dalam mengidentifikasi dan memitigasi bias dalam sistem AI. Risetnya berfokus pada bagaimana algoritma dapat memperpetuasi atau bahkan memperburuk bias yang ada dalam data pelatihan, yang pada gilirannya dapat menyebabkan hasil yang tidak adil bagi kelompok-kelompok tertentu. Ia mengembangkan metodologi riset untuk memastikan keadilan dalam pengembangan dan penerapan teknologi, menekankan pentingnya keberagaman dalam tim AI untuk mengurangi bias yang tidak disengaja.

3.2. Pengenalan Wajah dan Disparitas Gender/Ras

Salah satu kontribusi Gebru yang paling berpengaruh adalah risetnya yang berjudul Gender Shades, yang ditulis bersama Joy Buolamwini. Studi ini secara empiris mengungkap perbedaan akurasi yang signifikan dalam sistem pengenalan wajah komersial berdasarkan gender dan ras. Temuan kunci menunjukkan bahwa sistem-sistem ini secara substansial kurang akurat dalam mengidentifikasi wanita kulit hitam dibandingkan pria kulit putih, dengan perbedaan akurasi mencapai 35%. Riset ini menyoroti bias yang melekat dalam teknologi pengenalan biometrik dan memicu perdebatan luas tentang bahaya penggunaan teknologi tersebut, terutama untuk tujuan penegakan hukum dan keamanan. Gebru secara terbuka menyatakan bahwa teknologi pengenalan wajah terlalu berbahaya untuk digunakan secara luas dalam konteks tersebut.

3.3. Bahaya Model Bahasa Besar (LLM)

Makalah Gebru yang berjudul "On the Dangers of Stochastic Parrots: Can Language Models Be Too Big? 🦜" menganalisis secara kritis risiko yang terkait dengan model bahasa besar (LLM). Makalah ini membahas beberapa bahaya, termasuk:

- Jejak lingkungan dan biaya finansial: Pelatihan LLM membutuhkan daya komputasi yang sangat besar, yang berdampak signifikan pada lingkungan dan memerlukan investasi finansial yang substansial.

- Ketidakjelasan dan bias yang melekat: Model-model ini seringkali terlalu kompleks untuk dipahami sepenuhnya, sehingga sulit untuk mengidentifikasi dan menghilangkan bias yang mungkin mereka perkuat dari data pelatihan.

- Potensi penyalahgunaan: LLM dapat digunakan untuk menyebarkan disinformasi dan propaganda dalam skala besar, mengancam integritas informasi dan proses demokrasi.

- Keterbatasan pemahaman konseptual: Makalah ini berpendapat bahwa LLM, meskipun mahir dalam menghasilkan teks yang koheren, tidak memiliki pemahaman konseptual yang sebenarnya tentang bahasa yang mereka proses, sehingga berpotensi menghasilkan informasi yang menyesatkan atau tidak akurat.

3.4. Etika AI dan Dampak Sosial

Melalui riset dan advokasinya, Gebru secara konsisten mengeksplorasi dampak etis dan sosial teknologi AI, khususnya terhadap kelompok-kelompok marginal dan komunitas yang terpinggirkan. Ia berargumen bahwa pengembangan AI harus mempertimbangkan konsekuensi sosialnya secara cermat, dan bahwa teknologi harus dirancang untuk melayani seluruh umat manusia, bukan hanya segelintir orang. Gebru mengusulkan solusi perbaikan untuk menciptakan AI yang lebih bertanggung jawab dan adil, termasuk melalui peningkatan transparansi, akuntabilitas, dan partisipasi yang lebih luas dari beragam suara dalam proses pengembangan AI.

4. Aktivisme Sosial dan Advokasi

Timnit Gebru adalah seorang aktivis yang vokal, mendedikasikan dirinya untuk mempromosikan keragaman, keadilan, dan etika dalam bidang AI dan teknologi secara luas.

4.1. Pendirian Bersama dan Aktivitas Black in AI

Bersama dengan rekan kerjanya Rediet Abebe, Gebru mendirikan Black in AI, sebuah komunitas peneliti kulit hitam yang bekerja di bidang kecerdasan buatan. Tujuan utama Black in AI adalah untuk mendemokratisasi akses ke bidang kecerdasan buatan dengan meningkatkan kehadiran, visibilitas, dan kesejahteraan para profesional dan pemimpin kulit hitam di bidang tersebut. Sejak 2017, Black in AI telah menyelenggarakan lokakarya di konferensi tahunan Neural Information Processing Systems (NIPS), menyediakan platform penting bagi para peneliti kulit hitam untuk mempresentasikan karya mereka dan membangun jaringan. Situs web Black in AI dapat diakses di [https://blackinai.github.io/ blackinai.github.io].

4.2. Promosi Keragaman dan Inklusi dalam Teknologi

Gebru secara aktif mengadvokasi peningkatan partisipasi perempuan dan minoritas dalam bidang STEM dan AI. Ia secara terbuka membahas tantangan yang dihadapi oleh kelompok-kelompok yang kurang terwakili di industri teknologi, termasuk bias dan pelecehan, dan mendorong penciptaan lingkungan kerja yang lebih inklusif dan adil. Ia percaya bahwa kurangnya keragaman dalam tim pengembangan AI secara inheren menyebabkan sistem AI yang bias dan merugikan.

4.3. Kritik terhadap TESCREAL dan Etika Teknologi

Gebru, bersama dengan Émile P. Torres, menciptakan akronim neologisme TESCREAL untuk mengkritik sekelompok filosofi futuristik yang tumpang tindih: transhumanisme, extropianisme, singularitarianisme, kosmisme, rasionalisme, altruisme efektif, dan longtermisme. Gebru menganggap filosofi-filosofi ini sebagai pengaruh sayap kanan dalam Big Tech dan membandingkan para pendukungnya dengan "eugenis abad ke-20" dalam produksi proyek-proyek berbahaya yang mereka gambarkan sebagai "bermanfaat bagi umat manusia."

Gebru secara khusus mengkritik penelitian ke dalam kecerdasan umum buatan (AGI) sebagai berakar pada eugenika. Ia menyatakan bahwa fokus harus dialihkan dari AGI dan mencoba membangun AGI adalah praktik yang secara inheren tidak aman. Pandangan kritisnya menyoroti kekhawatiran tentang arah pengembangan AI yang terlalu ambisius tanpa mempertimbangkan implikasi etika dan sosial yang mendalam.

5. Penghargaan dan Pengakuan

Timnit Gebru telah menerima berbagai penghargaan dan pengakuan atas kontribusinya yang signifikan dalam bidang etika kecerdasan buatan dan advokasi sosial.

- 2019:** Gebru, bersama Joy Buolamwini dan Inioluwa Deborah Raji, memenangkan Penghargaan Inovasi AI VentureBeat dalam kategori AI for Good atas penelitian mereka yang menyoroti masalah signifikan bias algoritmik dalam pengenalan wajah.

- 2021:** Ia dinobatkan sebagai salah satu dari 50 Pemimpin Terbesar Dunia oleh majalah Fortune. Pada tahun yang sama, ia juga masuk dalam daftar sepuluh ilmuwan yang memiliki peran penting dalam perkembangan ilmiah pada tahun 2021 yang disusun oleh jurnal ilmiah Nature.

- 2022:** Gebru dinobatkan sebagai salah satu orang paling berpengaruh oleh majalah Time.

- 2023:** Ia diakui oleh Carnegie Corporation of New York sebagai penerima Penghargaan Imigran Hebat (Great Immigrants Award) atas kontribusinya yang luar biasa di bidang etika kecerdasan buatan. Pada November 2023, ia juga masuk dalam daftar 100 Wanita BBC sebagai salah satu wanita paling inspiratif dan berpengaruh di dunia.

6. Pengaruh dan Warisan

Timnit Gebru telah meninggalkan jejak yang tak terhapuskan dalam diskursus etika kecerdasan buatan, praktik industri teknologi, dan pemberdayaan kelompok-kelompok yang terpinggirkan dalam bidang STEM. Keberaniannya untuk menyuarakan kritik terhadap praktik-praktik industri yang bias dan tidak etis telah memaksa perusahaan-perusahaan teknologi besar untuk menghadapi masalah-masalah sistemik dalam pengembangan AI mereka.

Melalui risetnya yang inovatif, terutama pada bias algoritmik dan pengenalan wajah, Gebru telah secara fundamental mengubah cara para peneliti dan praktisi memahami dan mengatasi ketidakadilan dalam sistem AI. Pekerjaannya pada Gender Shades menjadi tolok ukur yang kritis, memicu kesadaran global tentang bagaimana teknologi dapat memperpetuasi diskriminasi rasial dan gender.

Pendirian Black in AI dan Distributed Artificial Intelligence Research Institute (DAIR) adalah warisan penting lainnya. Inisiatif-inisiatif ini tidak hanya menciptakan ruang bagi para peneliti kulit hitam dan terpinggirkan untuk berkembang, tetapi juga mendorong agenda riset yang berpusat pada keadilan sosial dan dampak AI di komunitas yang seringkali terabaikan. Gebru telah menjadi simbol perlawanan terhadap budaya "move fast and break things" di Silicon Valley, mengadvokasi pendekatan yang lebih hati-hati, inklusif, dan bertanggung jawab terhadap inovasi teknologi. Pengaruhnya terus membentuk masa depan AI yang lebih etis dan adil, menantang status quo dan menginspirasi generasi baru ilmuwan dan aktivis untuk memprioritaskan manusia di atas keuntungan.

7. Publikasi Terpilih

Berikut adalah beberapa publikasi akademis utama Timnit Gebru:

- Gebru, Timnit. "Visual computational sociology: computer vision methods and challenges." Tesis doktoral, Universitas Stanford, 2017.

- Gebru, Timnit, et al. "Using deep learning and Google Street View to estimate the demographic makeup of neighborhoods across the United States." Proceedings of the National Academy of Sciences, vol. 114, no. 50, 2017, hlm. 13108-13113.

- Buolamwini, Joy, dan Timnit Gebru. "Gender Shades: Intersectional Accuracy Disparities in Commercial Gender Classification." Proceedings of Machine Learning Research, vol. 81, 2018, hlm. 1-15.

- Gebru, Timnit. "Race and Gender." The Oxford Handbook of Ethics of AI, diedit oleh Markus D. Dubber, Frank Pasquale, dan Sunit Das, Oxford University Press, 2020, hlm. 251-269.

- Gebru, Timnit, dan Émile P. Torres. "The TESCREAL bundle: Eugenics and the promise of utopia through artificial general intelligence." First Monday, vol. 29, no. 4, 2024.